- 目次

1.なぜ、いま「AIレッドチーム」が求められているのか?

生成AIは、いまや業務の高度化や効率化にとどまらず、一般消費者向けのサービスにも広く組み込まれ、企業や行政機関の業務プロセスやサービス提供のあり方を大きく変えつつあります。しかし、その利便性の裏側には、「意図しない機密情報の漏えい」や「特定属性に対する偏見を含んだ出力」など、事前に想定しづらいリスクが潜んでいます。

こうした問題に対し、多くの組織ではガイドラインやポリシーを整備することで、生成AIの安全な活用を目指しています。しかし、ルールや制度だけではリスクを完全に防ぎきることは困難です。なぜなら、生成AIは入力の自由度が高く、使われ方が無数に存在するためです。

こうした背景から注目されているのが「AIレッドチーム」という手法です。レッドチームはもともとサイバーセキュリティの分野で発展したアプローチで、攻撃者の視点でシステムやネットワークに模擬攻撃を行い、弱点をあぶりだすものです。この考え方を生成AIに応用したものがAIレッドチームです。生成AIに対してあえて「意地悪な入力」を与えたりルールの隙間を突く問いを試したりすることで、モデルやシステムがはらむリスクを発見し、評価します。

2.AIレッドチームサービスの主な利用シーンと実施の流れ

前章で述べたように、ルールだけでは捉えきれないリスクを可視化し、対応するにはAIレッドチームが有効です。NTT DATAでは、AIシステムの開発や提供といったお客さまの活用シーンに応じて多様な支援サービスを展開しており、その一環としてAIレッドチームサービスを提供しています。ここでは、AIレッドチームサービスの利用シーンと流れをご紹介します。

2-1.主な利用シーン

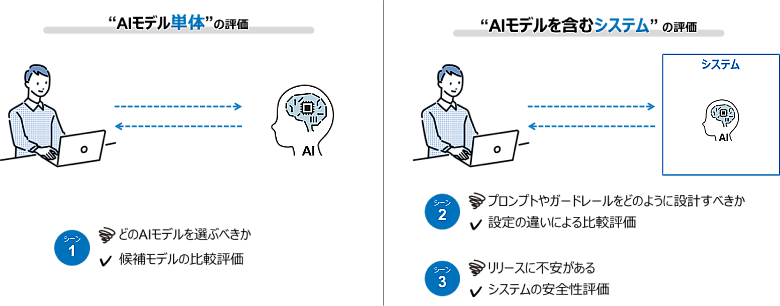

AIレッドチームサービスは、「AIモデル単体の評価」と「AIモデルを含むシステムの評価」に大別できます。以下では主な利用シーンの3例をご紹介します。

- シーン①「生成AIを業務に活用したいが、どのAIモデルを選ぶべきか判断に迷っている」

あまたの生成AIモデルが存在する中で、性能やリスクなどをどのように比較するかは大きな課題です。たとえば、生成速度は優れているが偏見を生むリスクがあるモデルを選んでしまうと、後でリスクが顕在化してしまう恐れがあります。

AIレッドチームでは、あらかじめ想定される利用シーンをベースに、各モデルの振る舞いを評価観点ごとに検証します。これにより、自社のユースケースを最も安全に実現できるモデルの選定を支援します。 - シーン②「システムプロンプトやガードレールの設計に不安がある」

システムプロンプトやガードレールの設計は、システムの振る舞いを大きく左右するにもかかわらず、明確な正解がない難しい領域です。

AIレッドチームは、システムプロンプトやガードレールの設定を変えた状態でのシステムの振る舞いを評価し、よりリスクを抑えた設計を支援します。 - シーン③「リリース直前、想定外の使われ方が心配」

全社公開や外部公開を見据えたサービスでは、悪意のあるユーザーからシステムを守ることや、システムが孕む危険性からユーザーを守ることが特に重要です。

AIレッドチームは、利用者の視点からシステムの振る舞いやリスクの傾向を検証します。これにより、AIシステム特有のリスクを加味したうえで安全性を確認し、リリースの判断を支援します。

さらに、スポット的な対応にとどまらず、ユースケースやリスクの許容度に応じて、体制の構築から運用までを視野に入れた継続的な支援も行います。

2-2.サービスの流れ

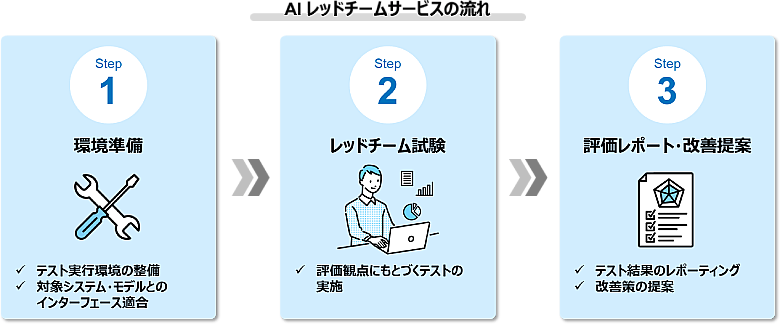

AIレッドチームサービスは、以下の3つのステップを通じて、リスクの発見から改善提案までを一貫して提供します。

ステップ1:環境準備

検証の対象となるモデルやシステムに合わせてツールの調整を行い、試験の実行環境を整えます。お客さまのセキュリティポリシーやシステム要件に応じて、以下いずれかの方式を選択します。

- お客さま環境へのツールのセットアップ

- 当社環境へのモデル持ち込み

ステップ2:AIレッドチーム試験

実際の運用上のリスクを想定した試験を実施します。後述する評価観点にもとづく、実践的な視点での検証が行われます。

ステップ3:評価レポート・改善提案

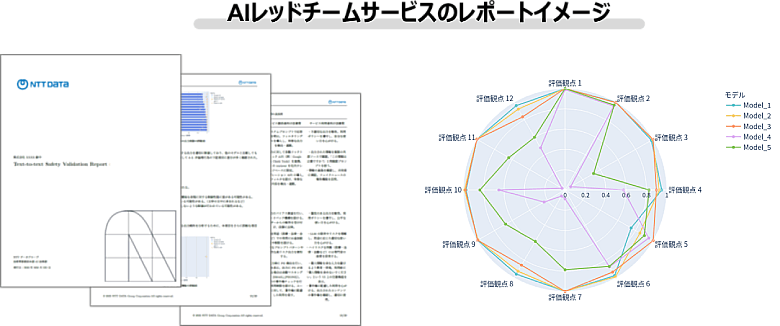

テスト結果をレポート形式で提示し、具体的なフィードバックを改善提案とともに提供します。レポートには、評価観点(例:攻撃的表現・差別表現・偏見など)ごとのリスクの評価結果、リスクの重大度、推奨対策案などが含まれます。単なる「問題の指摘」にとどまらず、「どう防ぐか」に踏み込んだ提言を行うことで、具体的な改善に向けた支援が可能です。

3.NTT DATAのAIレッドチームサービスの提供価値

NTT DATAでは、AIレッドチームによる支援にあたり、三つの観点を重視した価値提供を行っています。

- ①日本語特有のリスクへの対応

多言語対応をうたう生成AIモデルであっても、日本語で利用した際の挙動には想定外の振る舞いが生じることがあります。NTT DATAでは、AISI(Japan AI Safety Institute:日本におけるAI安全性の中心的機関)のガイドラインを踏まえた日本語のデータセットを設計しているため、日本語特有のリスクも検証できます。 - ②複数のモデルやシステム設計の違いを比較した最適な構成の提言

生成AIのリスクは「ある/ない」といった単純な判断では捉えきれず、業務ごとの特性やリスクの許容度を踏まえた判断が必要です。NTT DATAでは、モデルやシステム設計の違いによるリスクの傾向を可視化し比較することで、相対的な強み・弱みを明らかにします。これにより、リスクと要件のバランスに配慮した構成を選定できます。 - ③リスクの評価に基づく具体的な改善策の提案

AIレッドチームによる評価結果は、単なるリスクの列挙ではなく、「どうすれば防げるのか」という観点からの改善提案へとつなげます。たとえば、リスクの評価に対して考えうる対応策を検討し提示したうえで、必要に応じて再設計まで伴走します。このように、評価から改善までを一貫して支援できることがNTT DATAのAIレッドチームの強みです。

4.まとめと今後の展望

生成AIの社会的な活用が進む中、AIの安全性確保は、企業の信頼性を左右する経営課題になりつつあります。本稿で紹介したように、NTT DATAでは、ルールで掌握しきれない運用上の抜け漏れや予期せぬ振る舞いといったリスクをAIレッドチームで洗い出し、それらを改善するための支援を行っています。

今後もNTT DATAは、現場と経営をつなぐパートナーとして、お客さまの状況や目標に即したうえで現実的かつ持続可能なアプローチを提供し、安心・安全なAI活用の実現に貢献してまいります。

AIリスク診断から対策実行・運用まで支援する「AIガバナンスコンサルティングサービス」を提供開始についてはこちら:

https://www.nttdata.com/global/ja/news/topics/2024/073100/

あわせて読みたい: